Os Modelos de Linguagem Grandes (LLMs) desenvolveram-se enormemente num curto espaço de tempo, acumulando avanços incríveis.

E os projetos open source introduziram LLMs que competem de igual para igual com as soluções comerciais fechadas.

Isso facilitou o uso de LLMs, que podem ser adaptadas às necessidades dos usuários, tanto remota como em servidores locais.

Os LLMs são populares por criarem texto semelhante ao humano, traduzir idiomas e outras tarefas de processamento de linguagem natural.

No entanto, há duas maneiras principais de usá-los: na nuvem ou localmente. Cada abordagem tem seus prós e contras.

Prós ao rodar localmente

Oferece controle total sobre o hardware, software e dados.

Os usuários não precisam pagar por recursos de nuvem, o que pode economizar custos significativos.

Elimina a latência associada à transferência de dados para a nuvem.

Armazenar e processar dados localmente pode melhorar a segurança e a privacidade.

Contras ao rodar localmente

Requer investimentos significativos em hardware de alta potência.

Os usuários são responsáveis pelo gerenciamento e manutenção do hardware, o que pode ser demorado.

Dimensioná-las pode ser desafiador e caro, podendo ser mais difícil do que na nuvem.

Preciso de uma LLM local?

Instalar um modelo de linguagem num servidor local não é tecnicamente proibitivo, mas também não é moleza.

Mas deve-se considerar os seguintes pontos, para tomar a decisão correta:

- precisa de um modelo personalizado

- deseja estudar o funcionamento dos LLMs

- não quer compartilhar dados na nuvem

Embora rodar um LLM localmente ofereça controle total sobre os dados e reduza os custos de execução, necessita de pessoal com conhecimento técnico específico para tal.

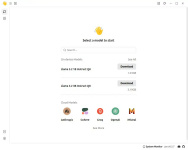

Jan: LLM opensource 100% offline

Embora os LLM sejam poderosos em recursos, trazem preocupações sobre segurança e privacidade dos dados, não só pelo tráfego na rede, como pelo armazenamento externo.

O Jan é uma alternativa de código aberto executada offline, oferecendo uma solução mais segura e privada.

Ele substitui os LLMs comerciais, fornecendo recursos semelhantes sem as desvantagens dos serviços baseados na nuvem.

Roda num computador local, permitindo o controle de seus dados em um ambiente seguro e privado.

Com essas características, pode ser a solução ideal para suas necessidades, sem se preocupar com a exposição indevida dos dados.

O LLM jan baseia-se nas arquiteturas GPT-2 e GPT-3, especializadas no processamento de linguagem natural, como geração de texto e resposta a perguntas.

O GPT-2 e o GPT-3 são LLMs capazes de realizar muitas tarefas, incluindo:

- geração de escrita criativa

- resumo de texto

- resposta a consultas de codificação

Assim, o Jan oferece recursos avançados de processamento de linguagem natural, substituindo muito bem o ChatGPT e similares comercias.

Requisitos do sistema

Abaixo estão as especificações mínimas a serem observadas, para que o LLM rode de forma adequada:

- OS - Ubuntu, Debian, Fedora etc.

- processador - Intel Core i3 ou equivalente

- RAM - 4 GB ou superior.

- armazenamento - 10 GB (preferível SSD).

- gráficos - placa integrada.

- python - versão 3.7 ou superior.

Ele tem dois pacotes para instalação, deb e appimage. Os procedimentos são fáceis de realizar e as instruções estão disponíveis aqui.

Fonte: links no texto e na imagem