Oi pessoal!

Hoje eu vou mostrar de forma prática e rápida como configurar o Ollama dentro de um sistema Linux para que ele possa ser acessado de outro host.

Isso é útil para o caso de você querer rodar um servidor de IA usando o Ollama em um equipamento e acessar ele através de outro, ou até mesmo de outra interface, como o OpenWebUI.

Como expor o Ollama para a sua rede

O primeiro passo é editar o serviço do Ollama.

sudo systemctl edit ollama.service

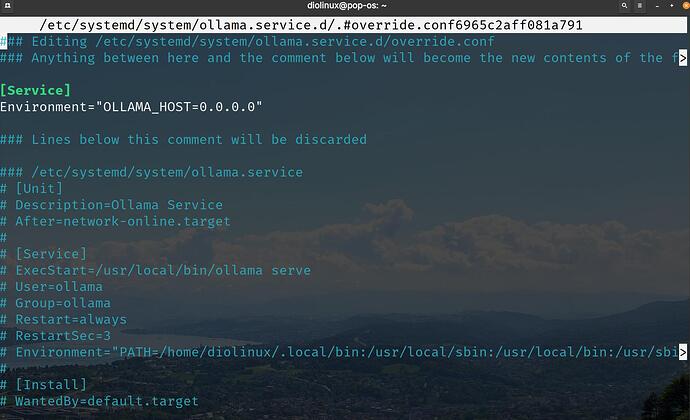

Ao abrir esse arquivo, adicione na parte superior dele a sessão abaixo:

[Service]

Environment="OLLAMA_HOST=0.0.0.0"

O resultado deve ser semelhante à imagem abaixo.

Salve e saia com CTRL+X e depois Y ou S (dependendo do idioma).

O próximo passo é reiniciar o daemon de carregamento e o próprio Ollama, isso pode ser feito com os seguintes comandos:

sudo systemctl daemon-reload

sudo systemctl restart ollama

Depois disso você deve conseguir acessar o Ollama como um serviço backend na sua rede.

Para testar, basta tentar acessar o Ollama pelo endereço de IP do computador/servidor onde ele estiver rodando usando a porta padrão, geralmente será algo como: 192:168.0.110:11343

Substituindo, claro, o endereço de IP de exemplo, pelo IP da sua máquina Linux.

Pelo terminal, é possível identificar facilmente o IP usando o comando:

hostname -I

E é isso, bom proveito! ![]()